OpenAI가 올해 GPT-5 대신 GPT-4.5를 출시할 가능성이 훨씬 더 높은 이유

| 출처 | https://wccftech.com/here-is-why-openai-is-much-more-likely-to-release-gpt-4-5-this-year-instead-of-gpt-5/ |

|---|

오호,, 기대되네요

GPT-4는 현재 점점 더 복잡해지는 생성 인공 지능 세계의 정점에 있지만 Anthropic의 Claude 및 Meta의 오픈 소스 Llama를 포함한 경쟁업체는 계속해서 향상되어 OpenAI의 주력 제품인 LLM(대형 언어 모델)의 또 다른 반복이 필요합니다. 많은 사람들이 Sam Altman의 비영리 단체가 2024년에 GPT-5를 출시할 것으로 예상 하지만 , 일부 분석가들은 특히 필요한 리소스의 규모를 고려할 때 그러한 기대가 여전히 무리라고 주장하고 있습니다.

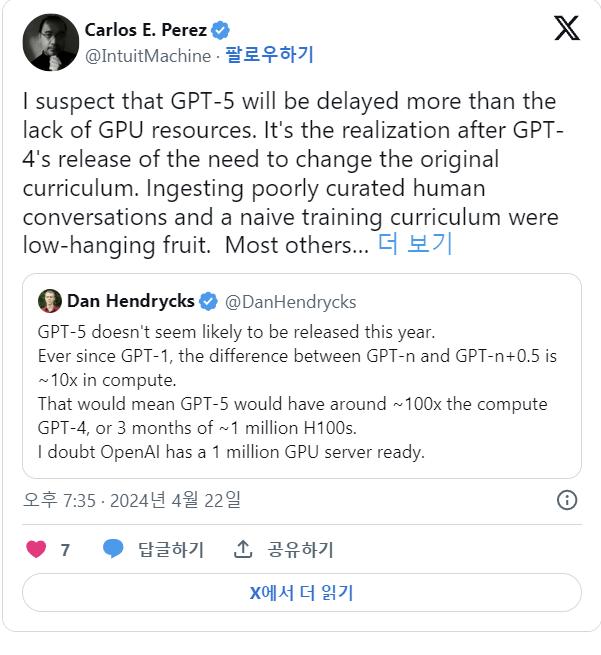

GPT-5에는 GPT-4의 약 100배 정도의 컴퓨팅 리소스 또는 3개월 동안 약 100만 개의 H100이 필요합니다.

AI 안전 센터 소장인 Dan Hendrycks에 따르면 OpenAI의 GPT LLM을 점진적으로 반복할 때마다 컴퓨팅 리소스가 10배 증가해야 합니다. 결과적으로 OpenAI가 GPT-4.5를 건너뛰고 GPT-5로 직접 점프한다면 GPT-4에 비해 계산 요구 사항이 약 100배 증가하는 것으로 해석됩니다. 이는 3개월 연속 실행되는 약 100만 개의 H100 칩에 해당합니다.

이 논문은 Anthropic의 CEO인 Dario Amodei의 의견에 의해 뒷받침됩니다. 그는 최근 최첨단 LLM을 교육하는 데 약 10억 달러의 비용이 소요되며, 이 비용은 2017년에 50억 달러에서 100억 달러 사이로 증가할 것으로 예상됩니다. 2025/26. 결정적으로, 10억 달러의 교육 비용은 GPT-4.5에 대해 합리적으로 추론할 수 있는 컴퓨팅 리소스의 10배 증가와 일치합니다.

최근 우리는 올해 배치된 NVIDIA의 H100 장치가 연간 약 13,000GWh 의 전력을 소비할 것으로 예상된다는 점을 언급했습니다. 이는 리투아니아 및 과테말라와 같은 국가의 연간 전력 소비량에 해당합니다. 2027년까지 데이터 센터의 전 세계 전력 소비량은 85~134TWh (테라와트시)까지 치솟을 것으로 예상됩니다!

앞서 GPT-4의 경쟁이 빠르게 따라잡고 있다고 언급했습니다. 글쎄요, 현재 Arena 리더십 보드에서 상위 5위 안에 드는 Meta의 Llama 3 LLM(700억 매개변수)을 살펴보세요. 비판적으로 Llama 3는 이제 다른 모든 오픈 소스 LLM보다 성능이 뛰어납니다. 이는 곧 출시될 4,050억 매개변수 모델이 없다는 점입니다.

더욱이 이제 일부 전문가들은 GPT-5가 "잘못 정리된 인간 대화"와 전반적인 "순진한" 교육 프로세스를 활용하는 "원래 커리큘럼"을 변경해야 한다고 믿고 있습니다. 이는 OpenAI가 GPT-5로 지분을 완전히 뒤집는 대신 올해 반복적인 GPT-4.5 모델을 출시할 가능성이 높다는 원래 논문에 추가됩니다.