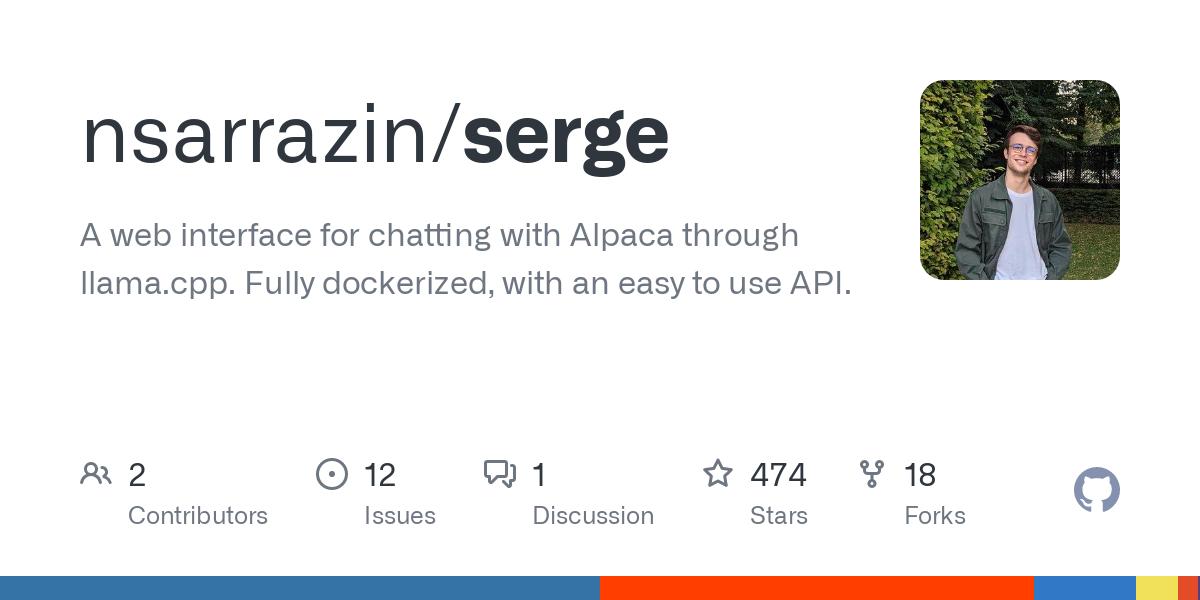

Chat GPT를 자체호스팅 ? Serge

제목이 어그로 같겠지만,, 어그로는 아닙니다.

한번 테스트해주실분 급구합니다 ㅋㅋ 한글이 되는지 궁금하네요

더 발전했으면,,,

llama.cppAlpaca 모델 실행을 기반으로 하는 채팅 인터페이스입니다 . 완전히 자체 호스팅되며 API 키가 필요하지 않습니다. 4GB RAM에 적합하며 CPU에서 실행됩니다.

- SvelteKit 프런트엔드

- 채팅 기록 및 매개변수 저장을 위한 MongoDB

- FastAPI + API용 비니, 다음으로 호출 래핑llama.cpp

시작하기

Serge 설정은 매우 쉽습니다. Alpaca 7B로 실행하기 위한 TLDR:

git clone https://github.com/nsarrazin/serge.git && cd serge cp .env.sample .env docker compose up -d docker compose exec api python3 /usr/src/app/utils/download.py tokenizer 7B

7B 13B 30B( 여러 모델을 다운로드하려면 인수로 전달할 수 있습니다 .)

그런 다음 http://localhost:8008/ 로 이동하면 됩니다.

모델

현재 7B, 13B 및 30B 알파카 모델만 지원됩니다. 위에서 설명한 컨테이너 내부에 다운로드하기 위한 다운로드 스크립트가 있습니다.

다른 프로젝트의 기존 가중치가 있는 경우 api/weights폴더에 추가할 수 있으며 빌드 시 자동으로 복사됩니다.

1등

1등 ai가 학습이 힘들지, 한번 학습시킨거 적용하고 사용하는건 쉽거든요!

요즘 라즈베리에서도 돌린다는데 docker까지 나왔었군요...

참고로 아직 상업적이용은 불가일겁니다(지구환경을 명분으로 풀어달라는 탄원도 있는걸로는 압니다)

잠시 월급루팡 하며 가지고 놀아봤는데 영어만 가능합니다.

4GB는 7B 모델에서만 가능하네요. 세션(대화)당 CPU 4코어를 풀로드 하고 첫 대화는 4기가. 이후 대화가 진행될 수록 약간씩 증가합니다. 8기가 정도는 되야 원활한 진행이 됩니다.

30B 모델도 돌려봤는데 코어 로드는 동일하고 메모리는 40기가 정도 먹네요. 그리고 응답속도도 매우 느려서 조금 긴 문장을 던지면 타임아웃에 걸립니다. CPU로는 한계가 있어보이네요.

32코어에 RTX A4000 달린 장비에서도 돌려봤는데 기본값으로는 그냥 CPU 4코어만 갈굽니다.

프로젝트 까서 만져주면 CPU를 다 쓰던지 GPU를 쓰던지 하게 할 수 있긴 하겠지만 루팡은 여기까지..ㅎㅎ

일단 한국어가 안 돼서 내부망만 되는 직원들 장난감으로 던져주기도 애매하네요

한국어만 지원되면 재미있을텐데요 ㅋㅋ

cmt alert