LocalAI로 나만의 GPT 만들어보기

안녕하세요. 달소입니다.

이번글에서는 앞서 소개해드린 LocalAI를 통해서 나만의 GPT를 만드는 방법입니다.

제일처음 소개해드린글이 아래글이였는데 벌써 2.12.4 버전까지나왔습니다.

https://svrforum.com/svr/821974

최신버전의 가장 좋은점은 AIO 즉, All In One 이미지를 제공해준다는 점 인데요.

docker run 한방으로 GPT를 바로 실행시킬 수 있습니다.

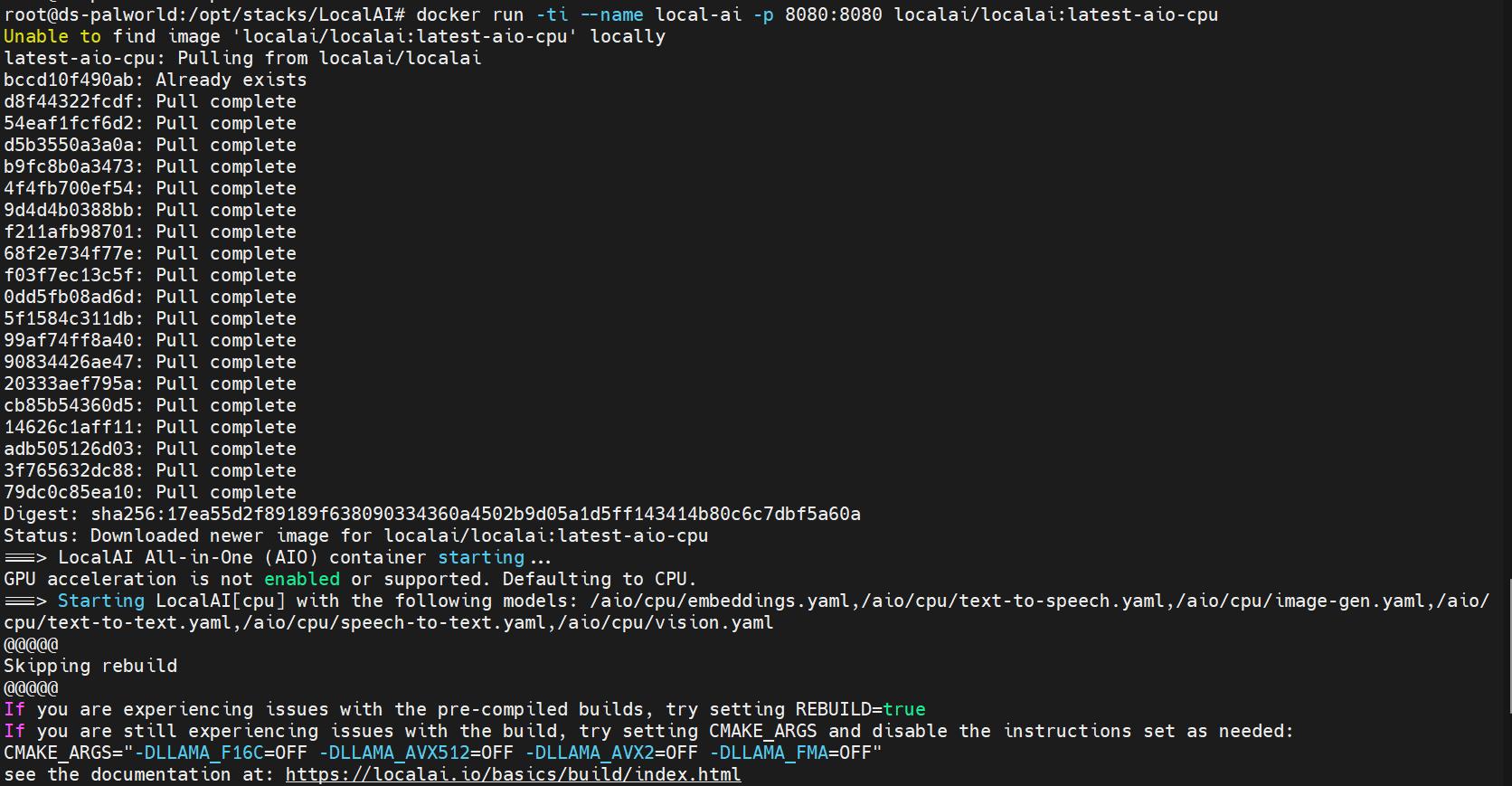

LocalAI 컨테이너 구동하기

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest-aio-cpu

바로 이미지를 받으면서 설치하는데 용량이 상당히 많이들어갑니다.

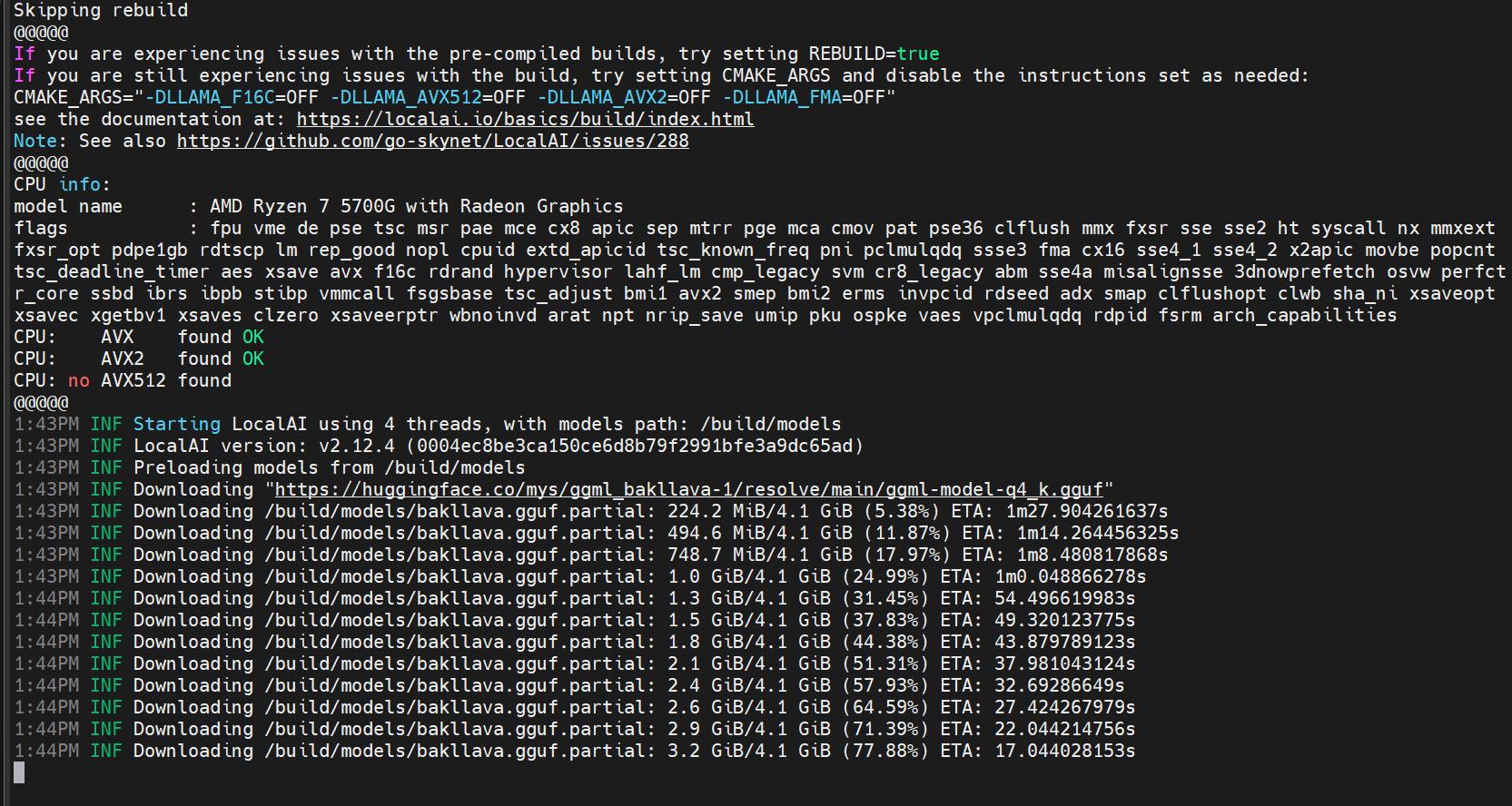

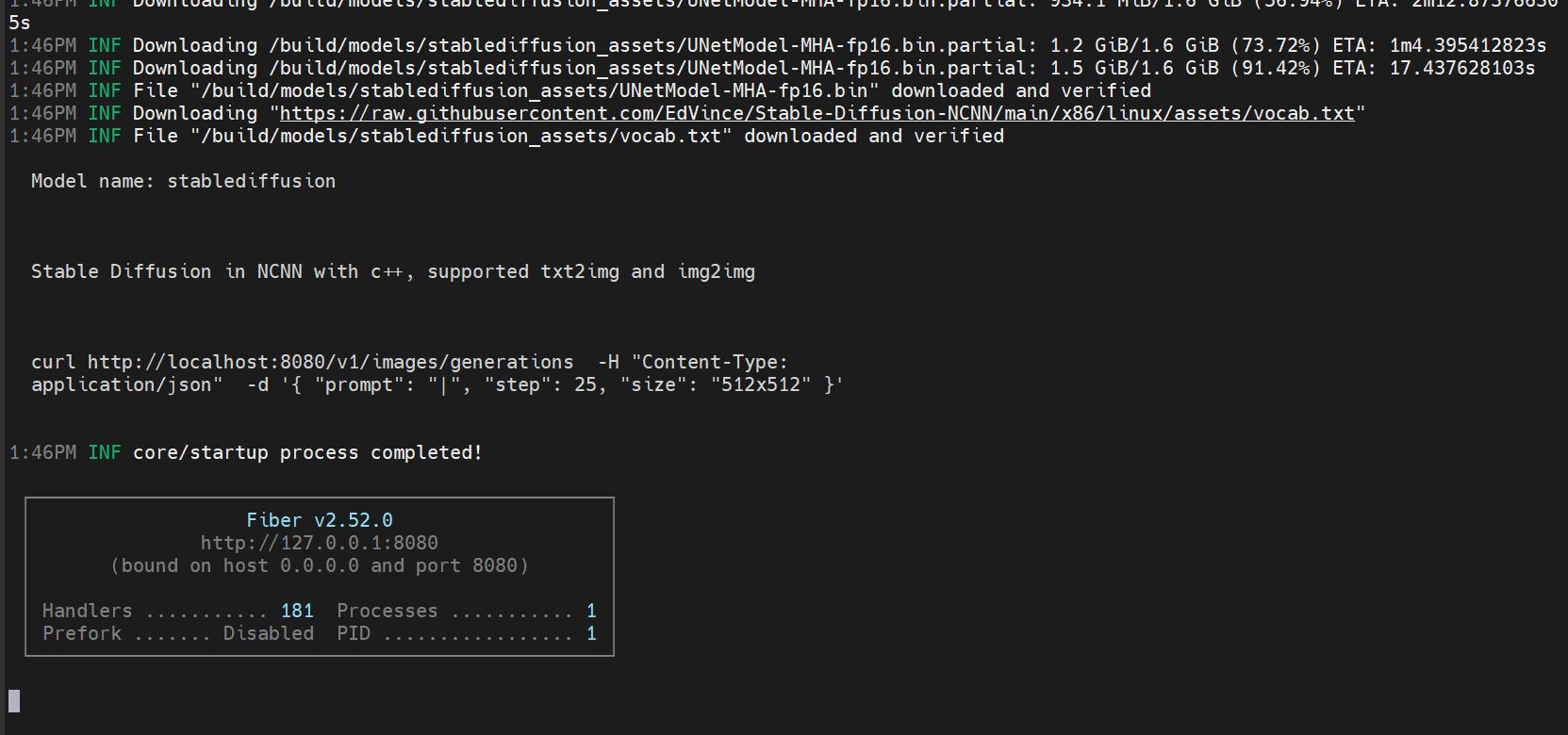

이미지를 다받으면 사용에 필요한 모델도 받습니다.

모델까지 다받으면 위 처럼 서비스가 실행됩니다.

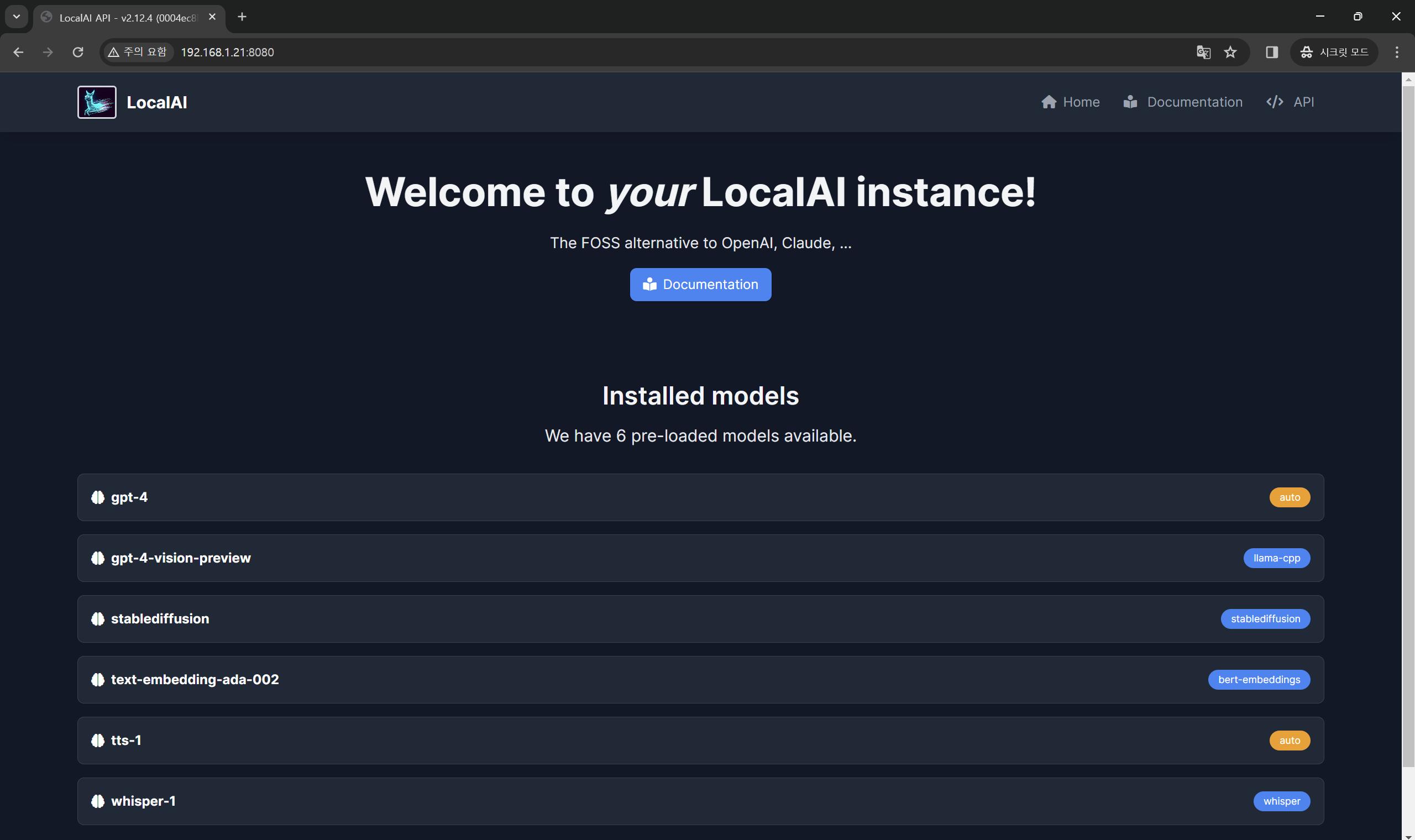

웹으로접근해보면 아래처럼 랜딩페이지가 나옵니다.

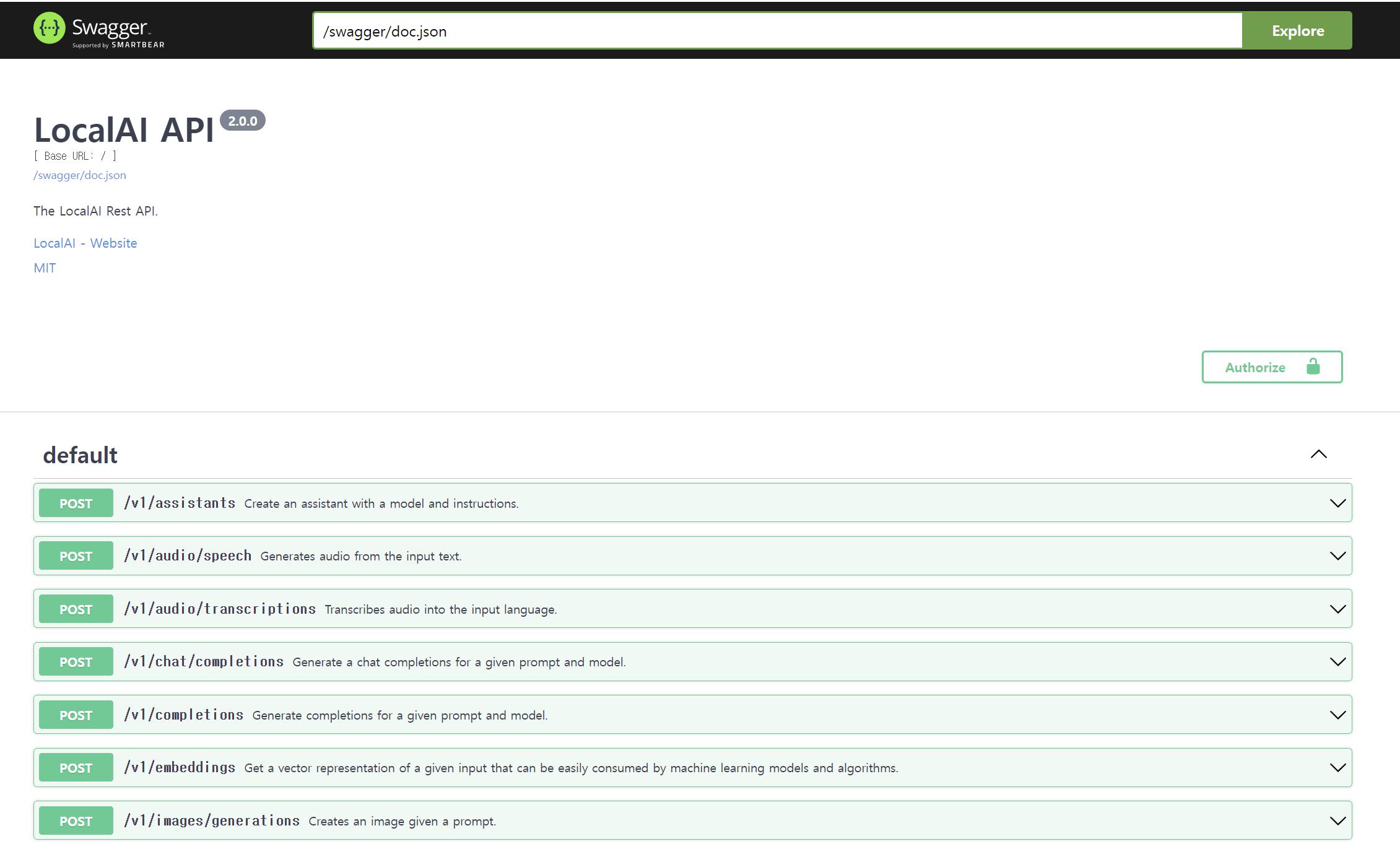

여기서 사용할 수 있는 언어가 나오고 우측상단에 API를 누르면

사용할 수 있는 스웨거가 나옵니다.

예시

예시로 간단한 사용방법입니다.

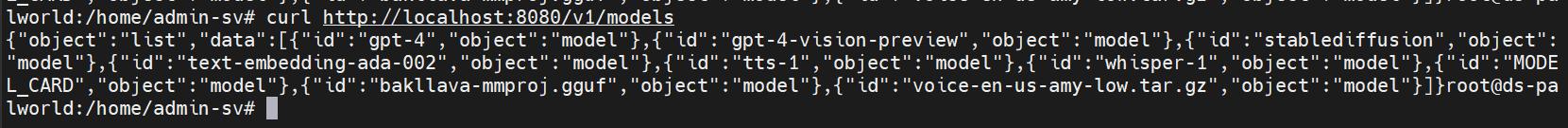

모델명 확인하기

curl http://localhost:8080/v1/models

GPT 호출하기

curl ip는 구동하는 ip로 변경해주시면됩니다.

curl http://192.168.1.21:8080/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "gpt-4",

"messages": [{"role": "user", "content": "여기에 질문하시면됩니다."}],

"temperature": 0.7

}'

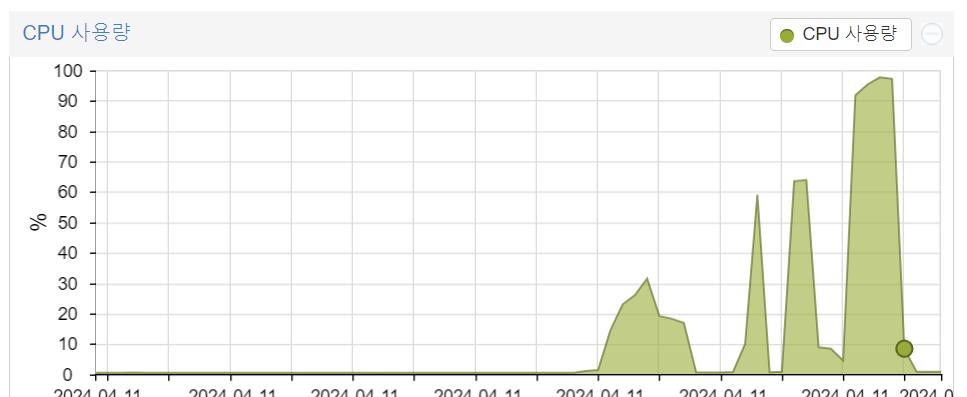

CPU 모델이라 그런지 질문하나당 리소스가 상당합니다.. 이럴거면 전기세가 더 나올것 같기도 ㅋㅋ

사실 이게 백엔드라고보면 되는데 프론트엔드도 하나 찾아봐서 연동하는걸 해봐야겠습니다.

cmt alert